ChatGPTのライバルとも言われる生成系AI、Google Bardに画像認識機能が追加されました。

かねてからChatGPTのGPT-4モデルにて画像認識機能が追加されるという発表がされていますが、いまだに未実装。そんななか、BardがChatGPTに先駆けてリリースという形になりました。

参考:試験運用版の最新情報

本記事では、Bardの画像読み取り機能の使い方や、その性能、本機能を使ってどんなことができるかをまとめたいと思います。

なお、Bardの基本的な情報については以下記事をご参照ください。

事前準備:Googleアカウントを英語に変更する

画像読み取り機能は、Googleアカウントを日本語から英語に変更する必要があります。

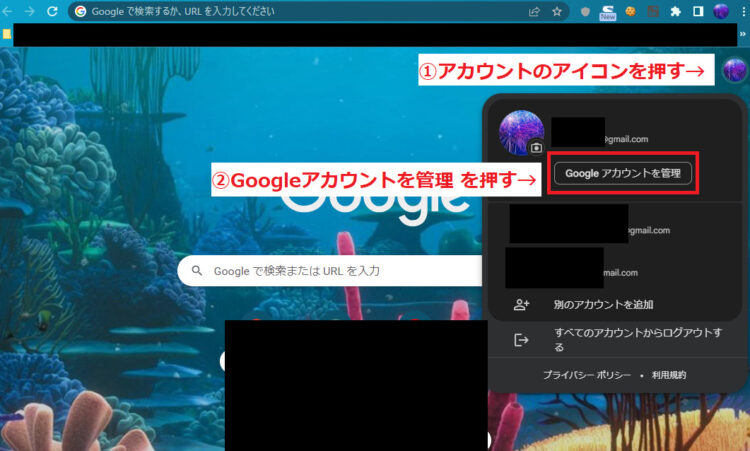

まず、右上にあるGoogleアカウントのアイコンを押し、「Googleアカウント管理」を選択します。

左側メニューの「個人情報」を選択し、「ウェブ向けの全般設定」>「言語」を押します。

「優先言語」の編集アイコンを押下

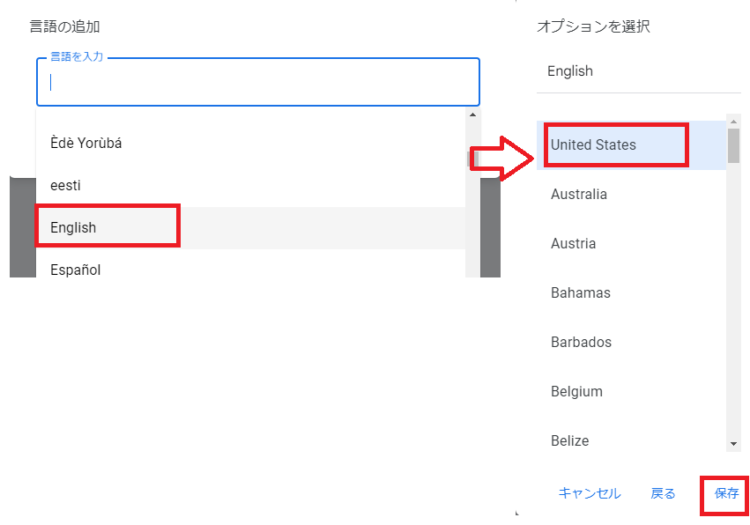

English/ United States を選択し、保存します。

これで画像読み取り機能が使えるようになります。

Bard画像読み取り機能の使い方

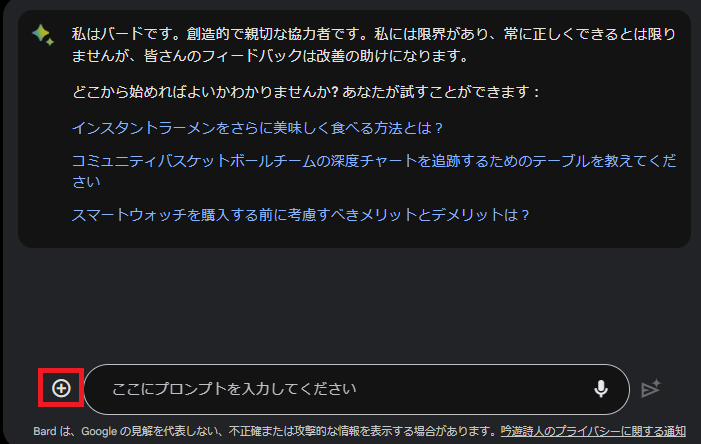

Googleアカウントの言語設定を英語にすると、Bardのプロンプト入力エリアに「+」マークが出現します。

Bardの画像読み取り機能でアップロードできる画像ファイルの種類はJPEG、PNG、WebPの3種類です。ちなみにWebPというのは、Googleが表示速度の短縮を目的に作った拡張子です。

画像をアップロードしたら、プロンプト(命令文)を入力して送信します。日本語には対応していないため、DeepLなどで英語に翻訳して送信します。

Bardの応答内容は以下の通りです。「これは何につかうもの?」という質問に対して、モニターアームであることを認識して用途を答えてくれています。

以上がBardの画像読み取り機能の基本的な使い方です。

Bardの読み取り機能でできること

以下に、Bardの読み取り機能でできることをいくつか紹介します。

製品の型番を調べる

Bardの読み取り機能では、画像を送信すると製品の型番を教えてもらうことができます。今回は、メーカーの公式画像で試しましたが、お店などで撮った写真に対しても正確に応答できればかなり便利そうです。

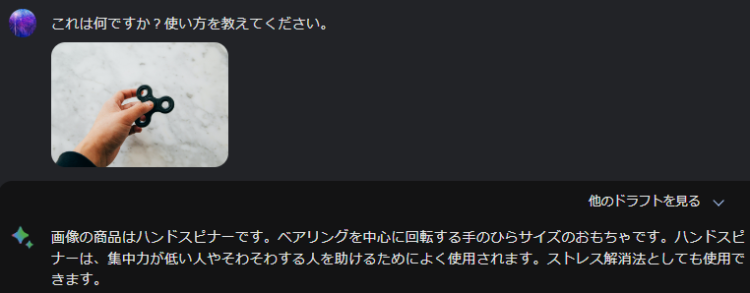

どんな商品か、どうやって使うのかを聞く

商品の画像とともに「これは何?使い方を教えて」と尋ねると、以下のようにモノの名称と使い方を教えてくれます。見たことあるけど名前が思い出せない、というときに便利です。

他にも、植物の育て方なども聞くことができます。

どんな画像かを説明してもらう

アップロードした画像がどんな画像であるかを説明してもらうことも可能です。

こちらは、コインランドリーに人が入り込んでいる画像です。この画像のおかしな点を指摘して、という指示に対して的確に状況を説明できています。ただ、表情までは見えていないので最後の一文はデタラメですね。。

性能はどうなの?

結論、性能はイマイチです。特に以下のような画像を読み取る精度が低く感じました。

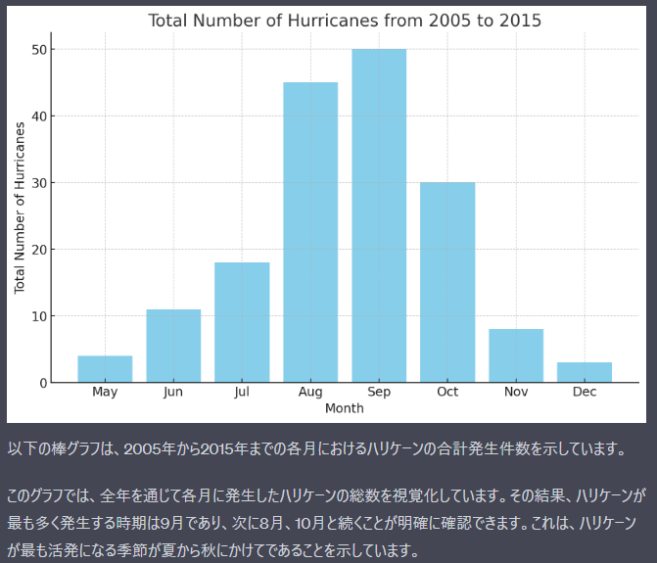

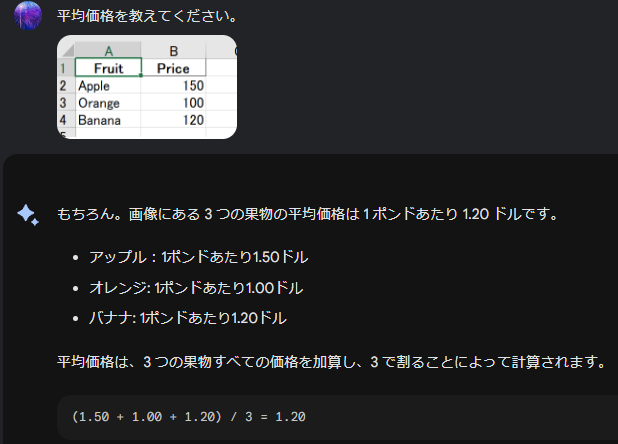

グラフや表の読み取り

特にグラフや表など細かい内容を読み取るのは難しそうです。

以下は、ChatGPTの「Code Interpreter」に生成させた、2005~2015年までのハリケーン発生総数のグラフです。

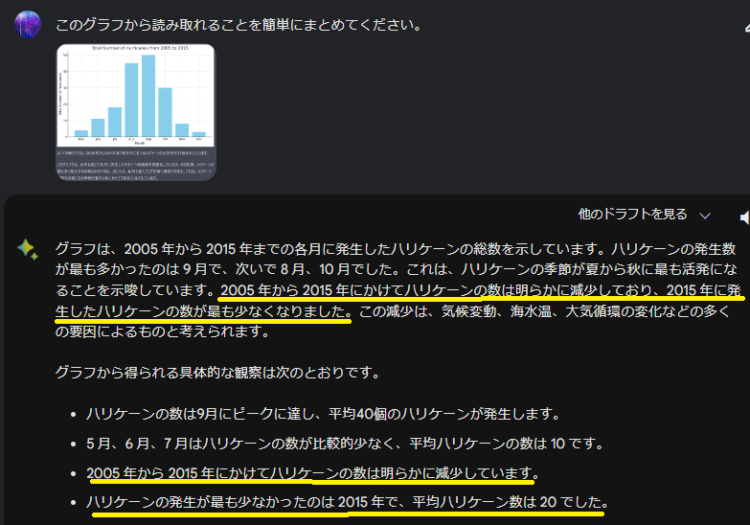

そして以下が、Bardにこのグラフから読み取れることを挙げてもらったものです。黄色い線を引いた箇所は、グラフとは異なる内容・グラフに書いていない内容です。

ツイッターあがっている例を見るとけっこう性能が良さそうに見えましたが、実際に使ってみると間違った回答をすることも多く、応答内容の正確性をチェックする必要がありそうだと感じました。

日本語の読み取り

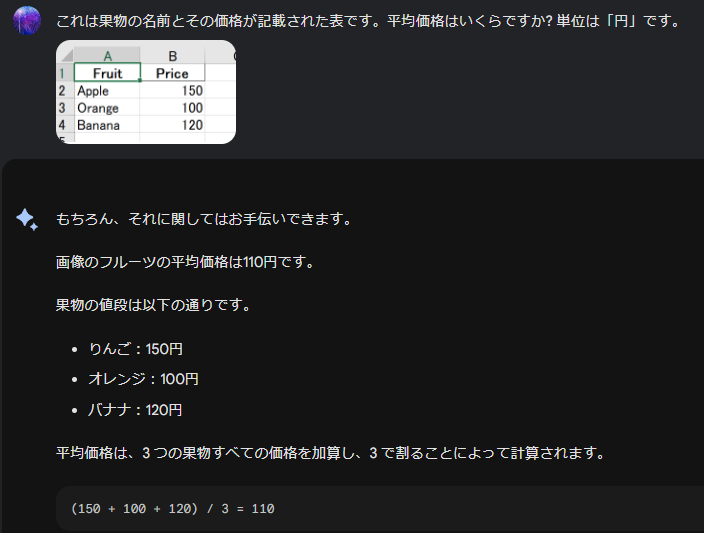

日本語を含む画像を読み取らせる際には、プロンプト(命令文)を細かく記載する必要がありそうです。

単に「平均価格を教えて」と指示するだけではうまくいきませんでした。

単位を指定したところ、平均価格を求める計算式は正しく出るようになりました。肝心の計算結果が間違ってますが・・・。何回か応答文を生成したところ、毎回計算結果が異なっていました。計算に関しては日本語うんぬん以前の問題ですね。

人物・場所の画像には対応していない

Bardの画像読み込み機能では、人物や場所の画像・イラストには対応していないようです。

以下の画像とともに、「この画像はなんの漫画のワンシーンですか?」という質問を投げました。

Bardの応答内容は以下のようになりました。

アップロードした画像は削除され、「人物の画像についてはまだ対応できません」と表示されました。

ChatGPT GPT-4の画像読み取り機能がなかなか実装されない理由のひとつがこれだと言われています。「この人はいまどこで働いている?」などの質問にAIが答えてしまう可能性があり、個人情報が漏れてしまう恐れがあるとされています。

そのため、画像だけでなくイラストにおいても答えないようになっているのではないかと思われます。場所を表す画像についても同様です。

まとめ

Bardの画像読み取り機能の使い方や、その性能、本機能を使ってどんなことができるかをまとめました。

単純な画像に関しては割と正確に読み取ることができている印象ですが、グラフや表、日本語の読み取りはイマイチでした。モノの画像を投げて「これはなに?」「どうやって使うの?」など聞くにはとても便利だなと思いました。

ただ、ChatGPTで懸念点とされリリースに至っていない、人物や場所の画像に関してはBardでも非対応でした。そうなるともはやGoogleレンズでしかないような気も。グラフや表の読み取りは先日ChatGPTに追加されましたしね。

今後、性能が改善されることに期待です。

コメント